核心结论先行

在 Django 项目中,直接使用多线程来处理并发 HTTP 请求通常不是最佳实践,并且可能是无效的。

你真正需要做的是:配置一个能够处理并发的 Web 服务器,而不是在 Django 代码内部创建和管理线程。

下面我们来详细解释为什么,以及正确的做法是什么。

为什么不建议在 Django 代码内部使用多线程?

a) Django 的“请求-响应”模型是同步的

Django 本身是一个同步框架,当一个 HTTP 请求到达时,它会经历以下过程:

- Web 服务器(如 Gunicorn)接收到请求。

- Web 服务器将请求传递给一个工作进程(Worker Process)中的一个线程(Thread)。

- Django 开始处理这个请求:解析 URL、查询数据库、执行业务逻辑、渲染模板。

- 这个线程会一直阻塞,直到所有处理完成,然后将完整的 HTTP 响应返回给 Web 服务器,再返回给客户端。

这个过程是线性的、同步的,如果一个请求中的某个操作非常耗时(比如一个复杂的数据库查询、调用一个外部 API),处理该请求的线程就会被卡住,直到这个操作完成,在这期间,这个线程无法处理任何新的请求。

b) Gunicorn 的并发模型(以 Gunicorn 为例)

Gunicorn 是最流行的 Python WSGI HTTP 服务器之一,它默认的并发模型是 "同步模型"(Sync Worker),但它通过多进程来并发处理请求。

gunicorn myproject.wsgi:application -w 4这个命令启动了 4 个工作进程(Worker Processes)。- 每个工作进程内部,默认会使用一个线程来处理请求(实际上是

syncworker,它会处理一个请求,然后处理下一个,是单线程的)。 - 当一个请求到达时,Gunicorn 会选择一个当前空闲的工作进程来处理它。

关键点: 如果你在 Django 代码里又创建了一个多线程,会发生什么? 假设你有一个视图函数,它启动了 5 个子线程来并行执行一些任务。

# views.py

import threading

import time

def slow_task():

print("开始执行耗时任务...")

time.sleep(10) # 模拟一个耗时10秒的操作

print("耗时任务完成")

def my_view(request):

# 创建5个线程来执行耗时任务

threads = []

for i in range(5):

t = threading.Thread(target=slow_task)

threads.append(t)

t.start()

# 主线程(处理这个HTTP请求的线程)会立即继续执行

return HttpResponse("后台任务已启动!")

当你访问 my_view 时:

- Gunicorn 的某个工作进程(Process A)中的一个线程(Thread 1)来处理这个请求。

my_view启动了 5 个子线程(Thread 2, 3, 4, 5, 6),这些线程和 Thread 1 属于同一个进程(Process A)。- 主线程 Thread 1 立即返回响应,不等待子线程完成。

- Process A 这个进程被这 6 个线程共享,如果这些线程都执行 I/O 密集型任务,它们可能会在等待 I/O 时让出 GIL,看起来是并行的,但如果它们是 CPU 密集型任务,由于 GIL 的存在,它们实际上并不能真正并行执行,反而会因为线程切换带来开销。

- 更重要的是,这个工作进程(Process A)现在被“占用”了,如果另一个新的 HTTP 请求进来,Gunicorn 可能会把这个请求也交给 Process A,但 Process A 内部的线程可能都在忙,导致新请求被阻塞。

在 Django 视图内部创建多线程,并不能有效地解决 Web 服务器层面的并发瓶颈,它只是把并发问题从“进程间”转移到了“进程内”,并且引入了不必要的复杂性(如线程同步、GIL 限制)。

正确的并发处理方式:使用合适的 Web 服务器

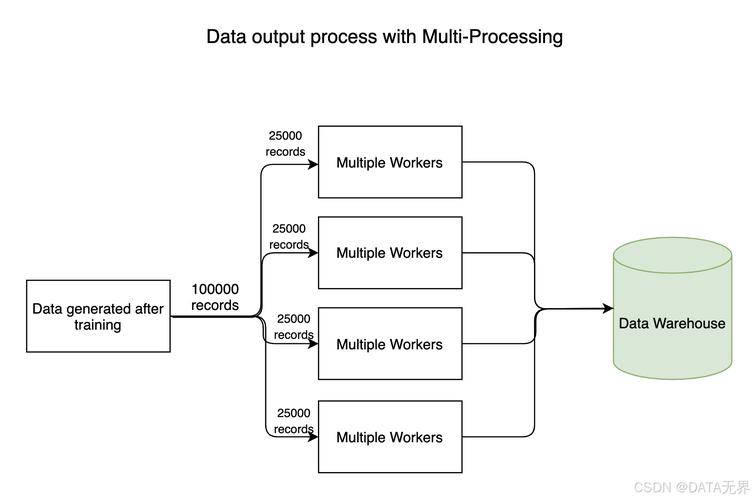

为了处理并发 HTTP 请求,我们应该依靠 Web 服务器的能力,Web 服务器通过管理多个工作进程和工作线程来同时处理多个请求。

a) 基于 Gunicorn 的多进程模型(最常用)

这是 Django 部署的标准做法,Gunicorn 通过启动多个工作进程来利用多核 CPU。

- 命令:

gunicorn --workers 4 myproject.wsgi:application - 原理: 启动 4 个独立的工作进程,每个进程都可以独立处理一个请求,如果一个进程在处理一个耗时请求时被阻塞,其他 3 个进程仍然可以正常接收和处理新的请求。

- 优点:

- 简单、稳定、易于管理。

- 利用多核 CPU,性能提升明显。 进程间内存是隔离的,一个进程崩溃不会影响其他进程。

- 适用场景: 绝大多数 Django 应用,特别是 I/O 密集型应用(如网站、API)。

b) 基于 Gunicorn 的多线程模型

如果你想让单个工作进程也能并发处理多个请求(比如处理大量短连接),可以为 Gunicorn 启用多线程 worker。

- 命令:

gunicorn --threads 2 --workers 2 myproject.wsgi:application - 原理: 启动 2 个工作进程,每个进程内部有 2 个线程,总共可以同时处理 4 个请求。

- 适用场景: 适用于 I/O 密集型任务,并且请求处理时间很短的情况,可以减少进程数量,节省内存,但对于 CPU 密集型任务,由于 GIL 的存在,线程并不能带来真正的性能提升。

c) 基于 Gevent 的协程模型(高性能 I/O 密集型)

对于高并发的 I/O 密集型应用(如聊天、实时通知),使用协程是更好的选择,因为它能以极低的资源消耗处理成千上万的并发连接。

- 命令:

gunicorn --worker-class gevent --workers 4 myproject.wsgi:application - 原理: Gevent 是一个基于协程的 Python 网络库,当一个请求在等待 I/O(如数据库查询、网络请求)时,Gevent 会自动切换到处理其他请求,而不是阻塞线程,这使得单个线程也能高效处理大量并发请求。

- 优点:

- 极高的并发能力。

- 内存占用非常低。

- 缺点:

- 需要 Django 应用是 "gevent-friendly" 的,即不能使用标准的、阻塞式的库(如

psycopg2的默认模式),通常需要使用异步驱动或打上猴子补丁 (monkey.patch_all())。 - 调试可能更复杂。

- 需要 Django 应用是 "gevent-friendly" 的,即不能使用标准的、阻塞式的库(如

什么时候才应该在 Django 内部使用多线程?

虽然处理 HTTP 请求不推荐,但在某些特定场景下,在 Django 应用内部使用多线程是合理的:

后台任务

这是最常见的使用场景,当你收到一个 HTTP 请求,但这个请求需要执行一个耗时操作(如发送邮件、生成报表、处理视频),你不应该让用户等待,最佳实践是:

- 立即返回响应: 告诉用户“任务已接收,正在后台处理”。

- 在后台启动线程: 启动一个新线程去执行这个耗时任务。

# tasks.py

def send_email_background(subject, body):

# 模拟发送邮件

import time

time.sleep(5)

print(f"邮件已发送: {subject}")

# views.py

from django.http import HttpResponse

import threading

from .tasks import send_email_background

def send_email_view(request):

subject = "来自Django的测试邮件"

body = "这是一封后台发送的邮件。"

# 创建一个新线程来执行邮件发送任务

thread = threading.Thread(target=send_email_background, args=(subject, body))

thread.start()

return HttpResponse("邮件发送任务已启动,请查收收件箱。")

CPU 密集型任务(不推荐,但可行)

如果你的应用有 CPU 密集型的计算任务,并且你希望利用多核 CPU,可以在 Django 的管理命令或独立脚本中使用多线程/多进程。

# myapp/management/commands/heavy_calc.py

from django.core.management.base import BaseCommand

import multiprocessing

def calculate(data):

# 模拟CPU密集型计算

result = sum(i*i for i in range(1000000))

return result

class Command(BaseCommand):

help = '执行一个CPU密集型任务'

def handle(self, *args, **options):

data_list = [1, 2, 3, 4] # 假设要计算4组数据

pool = multiprocessing.Pool(processes=4) # 使用进程池

results = pool.map(calculate, data_list)

self.stdout.write(self.style.SUCCESS(f'计算结果: {results}'))

注意: 对于 CPU 密集型任务,使用 multiprocessing(多进程)通常比 threading(多线程)更有效,因为它可以绕过 GIL 的限制,真正利用多核。

总结与最佳实践

| 场景 | 推荐方案 | 原因 |

|---|---|---|

| 处理并发 HTTP 请求 | 使用 Web 服务器的多进程/多线程/协程模型 | 这是 Web 服务器的设计职责,能高效、稳定地管理并发,且与 Django 的同步模型解耦。 |

| 在 HTTP 请求中执行耗时任务 | 立即响应,并在后台启动新线程 | 保持 Web 服务器的响应能力,提升用户体验,这是在 Django 内部使用线程最合理的场景。 |

| 执行 CPU 密集型任务 | 使用 multiprocessing 或 Celery |

绕过 GIL 限制,充分利用多核 CPU,对于长期任务,Celery 是更专业、更可靠的选择。 |

| 执行大量 I/O 密集型任务 | 使用 threading 或 asyncio |

让出 CPU,等待 I/O,提高效率,在 Django 项目中,threading 更简单。 |

最终建议:

- 对于 Web 服务: 坚持使用 Gunicorn(或 uWSGI)的多进程模型,这是最可靠、最简单的方案,如果并发量极高,再尝试 Gevent。

- 对于后台任务: 如果任务简单,用

threading即可,如果任务复杂、需要队列、重试、调度等功能,请使用专业的任务队列系统,如 Celery,Celery 本身就是基于多线程/多进程/协程构建的,是处理后台任务的工业级标准。 - 避免在 Django 视图逻辑中手动管理线程池来处理并发请求,这几乎总是错误的做法,并且会让你陷入麻烦。