什么是Checkpoint机制?

Checkpoint(检查点)是一种容错和恢复机制,它的核心思想是:在程序长时间运行的过程中,定期将程序的关键状态(模型参数、训练轮数、优化器状态、随机数生成器种子等)保存到持久化存储(如磁盘)中。

如果程序在后续运行中崩溃或被中断,下次可以从最近的检查点恢复,而不是从头开始,这对于训练深度学习模型、执行长时间的数据处理任务或科学计算至关重要,可以节省大量的时间和计算资源。

Checkpoint机制的核心要素

一个完整的Checkpoint机制通常包含三个部分:

-

需要保存的状态:这是程序在特定时间点的“快照”,对于不同类型的任务,状态内容也不同:

- 深度学习训练:模型权重 (

model.state_dict())、优化器状态 (optimizer.state_dict())、当前epoch/step数、损失值、学习率调度器状态等。 - 数据处理/科学计算:已处理的数据量、中间计算结果、随机种子、循环计数器等。

- 深度学习训练:模型权重 (

-

保存的时机:即何时触发保存操作。

(图片来源网络,侵删)

(图片来源网络,侵删)- 按时间间隔:每60分钟保存一次。

- 按步数/轮数:每训练100个batch或1个epoch保存一次,这是最常见的方式。

- 按条件触发:当验证集的准确率达到一个新的峰值时保存。

-

恢复的逻辑:程序启动时,首先检查是否存在有效的检查点文件,如果存在,则加载其中的状态,并从中断的地方继续执行。

Python实现Checkpoint的方法

在Python中,有几种不同层次和复杂度的方法来实现Checkpoint。

手动实现 (适用于简单脚本)

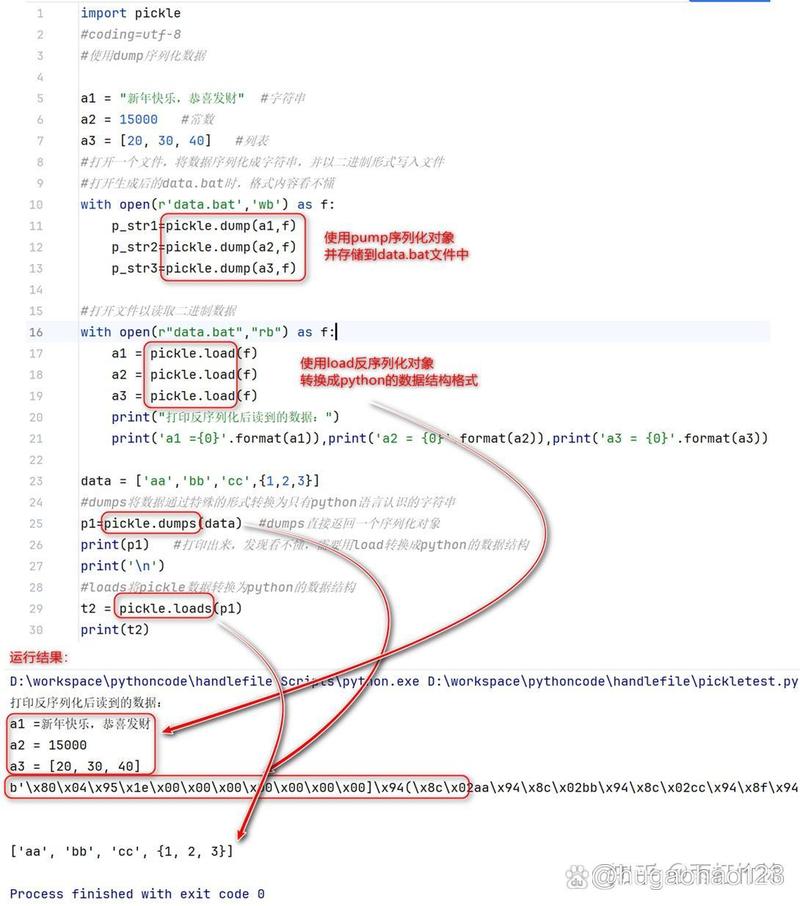

对于非常简单的脚本,你可以手动使用Python内置的 pickle 或 json 模块来保存和加载状态。

示例:模拟一个长时间计算任务

import os

import pickle

import time

# 定义计算任务的“状态”

class TaskState:

def __init__(self, start_value):

self.counter = start_value

self.start_time = time.time()

def long_running_computation(max_steps, checkpoint_interval=5, checkpoint_file='checkpoint.pkl'):

"""

模拟一个长时间运行的计算任务。

"""

# 1. 恢复检查点(如果存在)

if os.path.exists(checkpoint_file):

print(f"发现检查点文件 '{checkpoint_file}',正在恢复...")

with open(checkpoint_file, 'rb') as f:

state = pickle.load(f)

print(f"恢复成功!从 counter = {state.counter} 继续运行。")

else:

print("未发现检查点文件,从头开始运行。")

state = TaskState(start_value=0)

# 2. 执行任务

try:

for i in range(state.counter, max_steps):

print(f"正在处理步骤 {i + 1}/{max_steps}...")

# 模拟一些计算工作

time.sleep(1)

state.counter = i + 1

# 3. 在指定间隔保存检查点

if (i + 1) % checkpoint_interval == 0:

print(f"步骤 {i + 1} 完成,保存检查点...")

with open(checkpoint_file, 'wb') as f:

pickle.dump(state, f)

print("检查点已保存。")

except KeyboardInterrupt:

print("\n检测到中断!正在保存检查点...")

with open(checkpoint_file, 'wb') as f:

pickle.dump(state, f)

print(f"检查点已保存到 '{checkpoint_file}',程序退出。")

return

# 4. 任务完成,删除检查点文件

if os.path.exists(checkpoint_file):

os.remove(checkpoint_file)

print("任务完成!")

# 运行任务

long_running_computation(max_steps=20, checkpoint_interval=5)

如何测试:

- 运行脚本,它会执行5步,然后保存检查点。

- 再次运行脚本,它会发现检查点并从第6步继续。

- 在运行过程中按

Ctrl+C模拟中断,它会保存当前状态。

使用第三方库 (推荐)

对于更复杂的场景,特别是深度学习,手动实现繁琐且容易出错,使用专门的库是更好的选择。

torch.save / torch.load (PyTorch生态)

这是PyTorch中最标准、最常用的方法,它通常与 torch.nn.Module 和 torch.optim.Optimizer 结合使用。

核心组件:

model.state_dict():返回一个包含模型所有参数(权重和偏置)的字典。optimizer.state_dict():返回一个包含优化器状态(如动量、方差)的字典。torch.save(obj, path):将任意Python对象保存到文件。torch.load(path):从文件加载Python对象。

示例:PyTorch训练循环中的Checkpoint

import torch

import torch.nn as nn

import torch.optim as optim

# 1. 定义模型、优化器和损失函数

model = nn.Sequential(nn.Linear(10, 5), nn.ReLU(), nn.Linear(5, 1))

optimizer = optim.Adam(model.parameters(), lr=0.001)

loss_fn = nn.MSELoss()

# 定义检查点文件路径

checkpoint_path = 'training_checkpoint.pth'

# 2. 恢复函数

def load_checkpoint():

if os.path.exists(checkpoint_path):

print(f"从 {checkpoint_path} 加载检查点...")

checkpoint = torch.load(checkpoint_path)

model.load_state_dict(checkpoint['model_state_dict'])

optimizer.load_state_dict(checkpoint['optimizer_state_dict'])

epoch = checkpoint['epoch']

loss = checkpoint['loss']

print(f"恢复成功!从 epoch {epoch} 继续训练,损失为 {loss:.4f}。")

return epoch

print("从头开始训练。")

return 0

# 3. 保存函数

def save_checkpoint(epoch, loss):

print(f"保存检查点到 {checkpoint_path}...")

torch.save({

'epoch': epoch,

'model_state_dict': model.state_dict(),

'optimizer_state_dict': optimizer.state_dict(),

'loss': loss,

}, checkpoint_path)

print("检查点已保存。")

# 模拟训练数据

dummy_data = torch.randn(100, 10)

dummy_labels = torch.randn(100, 1)

# 4. 训练循环

start_epoch = load_checkpoint()

num_epochs = 20

for epoch in range(start_epoch, num_epochs):

# 模拟一个训练步骤

outputs = model(dummy_data)

loss = loss_fn(outputs, dummy_labels)

optimizer.zero_grad()

loss.backward()

optimizer.step()

print(f'Epoch [{epoch+1}/{num_epochs}], Loss: {loss.item():.4f}')

# 每5个epoch保存一次

if (epoch + 1) % 5 == 0:

save_checkpoint(epoch + 1, loss.item()) # 保存下一个epoch的编号

# 训练完成后,可以删除检查点

if os.path.exists(checkpoint_path):

os.remove(checkpoint_path)

print("训练完成,检查点已删除。")

Accelerate (Hugging Face)

Accelerate 是一个强大的库,它极大地简化了在多GPU、TPU或多机器环境下的训练流程,并内置了优雅的Checkpoint管理。

特点:

- 自动保存:通过简单的配置,可以自动在指定间隔保存模型和优化器状态。

- 自动恢复:可以轻松地从最新的检查点恢复训练。

- 分布式支持:无缝处理分布式环境下的Checkpoint。

示例:使用 Accelerate

# 首先安装: pip install accelerate

from accelerate import Accelerator

from transformers import BertForSequenceClassification, BertTokenizer, AdamW

import torch

from torch.utils.data import DataLoader, TensorDataset

# 1. 初始化 Accelerator

# 它会自动处理设备选择、分布式设置等

accelerator = Accelerator()

# 2. 准备模型、优化器、数据加载器

# 注意:这里不需要调用 .to(device)

model = BertForSequenceClassification.from_pretrained('bert-base-uncased', num_labels=2)

optimizer = AdamW(model.parameters(), lr=5e-5)

# 模拟数据

tokenizer = BertTokenizer.from_pretrained('bert-base-uncased')

texts = ["This is a positive sentence.", "This is a negative sentence."] * 10

labels = [1, 0] * 10

inputs = tokenizer(texts, padding=True, truncation=True, return_tensors="pt")

dataset = TensorDataset(inputs['input_ids'], inputs['attention_mask'], torch.tensor(labels))

dataloader = DataLoader(dataset, batch_size=2)

# 3. 使用 accelerator.prepare 包装模型、优化器和数据加载器

# 这会将它们移动到正确的设备,并为分布式训练做准备

model, optimizer, dataloader = accelerator.prepare(model, optimizer, dataloader)

# 4. 训练循环

num_epochs = 5

for epoch in range(num_epochs):

for step, batch in enumerate(dataloader):

input_ids, attention_mask, labels = batch

outputs = model(input_ids, attention_mask=attention_mask, labels=labels)

loss = outputs.loss

# 反向传播

accelerator.backward(loss)

optimizer.step()

optimizer.zero_grad()

if step % 2 == 0:

print(f"Epoch {epoch}, Step {step}, Loss: {loss.item()}")

# --- Checkpoint 管理变得非常简单 ---

# accelerator.save_state 会自动保存模型、优化器、epoch等所有必要信息

# 你只需要提供一个输出目录

accelerator.save_state(output_dir=f"checkpoint_epoch_{epoch+1}")

print(f"Epoch {epoch+1} 的检查点已保存。")

# 加载检查点也同样简单

# accelerator.load_state("checkpoint_epoch_3")

# print("已从 epoch 3 的检查点恢复。")

Checkpoint策略与最佳实践

-

保存什么?

- 模型状态:

model.state_dict()是必须的。 - 优化器状态:

optimizer.state_dict()对于恢复训练进度至关重要,特别是像Adam这样的自适应优化器。 - 训练状态:当前epoch/step数、全局步数、学习率等。

- 随机性:

random.getstate()和torch.manual_seed()等,以确保结果的可复现性。

- 模型状态:

-

何时保存?

- 定期保存:防止长时间运行后意外崩溃。

- 性能提升时:保存验证集/测试集性能最好的模型(即“最佳模型”检查点)。

- 保存多个版本:可以保留最近的N个检查点,而不是只覆盖一个文件,这样即使某个检查点损坏,也有备份可用。

-

保存到哪里?

- 对于大型模型,检查点文件可能非常大(GB级别)。

- 使用快速、高IOPS的存储,如本地SSD或网络文件系统。

- 考虑使用云存储服务(如S3)进行长期备份,但要注意上传/下载的延迟。

-

安全性

- 在保存时,先写入一个临时文件,写成功后再重命名为目标文件,这样可以防止写入过程中断导致文件损坏。

- PyTorch的

torch.save在内部已经处理了这个问题,比较安全。

| 方法 | 优点 | 缺点 | 适用场景 |

|---|---|---|---|

| 手动实现 | 灵活性高,不依赖外部库。 | 繁琐,容易出错,不适合复杂状态。 | 简单的脚本、非深度学习任务。 |

| PyTorch原生 | 标准做法,与PyTorch生态无缝集成,功能强大。 | 需要手动编写保存/加载逻辑。 | 几乎所有PyTorch项目。 |

| Hugging Face Accelerate | 极其简单,自动处理分布式和设备问题,内置管理。 | 引入了一个新的库,有一定的学习成本。 | 需要进行分布式训练或希望简化训练流程的开发者。 |

对于大多数Python项目,特别是涉及深度学习的,强烈推荐使用PyTorch原生方法或Hugging Face的Accelerate库,而不是从头手动实现,它们是健壮、高效且经过社区验证的解决方案。