Boosting算法终极指南:从AdaBoost到XGBoost,用Python实现机器学习“王者”

Meta描述: 深入浅出解析Boosting算法原理,对比AdaBoost、GBDT、XGBoost、LightGBM等主流模型,提供完整Python代码示例,助你掌握机器学习集成学习的核心技巧,提升模型性能。

引言:为什么你的模型总差那么“一点”?

在机器学习的世界里,我们常常会遇到这样的困境:经过精心调参的单个模型(如决策树、逻辑回归)表现平平,无论怎么优化,准确率/召回率就是无法突破瓶颈,你可能会问:“难道我的数据不行,还是我选错了模型?”

答案可能藏在更高级的技巧里——集成学习,而集成学习家族中,最耀眼、最强大的明星,无疑是Boosting算法。

Boosting算法,集众家之长,补一己之短”的智慧,它不是简单地堆砌多个模型,而是通过一种“ sequential”(串行)的方式,让每个新模型都专注于纠正前面模型的错误,这种“后浪推前浪”的学习方式,使得Boosting算法在各类数据科学竞赛和工业界应用中,屡屡创下性能新高。

我们将从零开始,彻底搞懂Boosting算法,并用Python亲手实现它们,让你从“会用”到“精通”,真正掌握机器学习的“王者”之术。

Boosting核心思想:从“弱学习器”到“强学习器”

要理解Boosting,首先要明白两个概念:

- 弱学习器:指那些性能仅比随机猜测好一点的简单模型,一个深度为1的决策树(也叫“决策桩”),它很容易训练,但单个模型的预测能力有限。

- 强学习器:指性能远超随机猜测的高精度模型,我们最终想要的,就是这样一个强大的模型。

Boosting的核心思想可以概括为三个步骤:

- 初始训练:在原始数据上训练一个弱学习器。

- 关注错误:增加被前一个模型预测错误样本的权重(或概率),让下一个模型更“关注”这些“难啃的骨头”。

- 迭代集成:不断重复步骤1和2,训练出一系列弱学习器,将这些弱学习器通过加权投票的方式组合起来,形成一个强大的强学习器。

这个过程就像一个学生做错题集,第一次做错的题,老师会重点讲解;第二次还错的题,老师会再加强调,经过几轮重点辅导,学生最终掌握了所有知识点。

Boosting算法家族“三国鼎立”

Boosting算法家族成员众多,但最主流、最常用的有三个“巨头”:AdaBoost、GBDT和XGBoost,下面我们来逐一解析。

1 AdaBoost (Adaptive Boosting) - 开山鼻祖

AdaBoost是Boosting算法的鼻祖,它的原理非常直观。

-

核心机制:

- 样本权重:训练开始时,所有样本的权重都相等。

- 训练弱学习器:用当前权重的数据集训练一个弱学习器(通常是决策桩)。

- 计算模型权重:根据弱学习器的“错误率”(Error Rate),计算该模型在最终集成中的权重(α),错误率越低,权重越高,说明这个模型越可靠。

- 更新样本权重:增加被该模型错误预测的样本的权重,减少正确预测样本的权重,这样,下一个模型就会被迫去学习那些“顽固”的样本。

- 循环:重复以上步骤,直到达到预设的弱学习器数量。

-

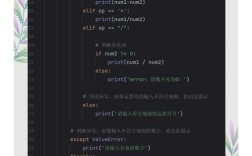

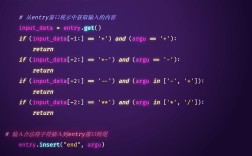

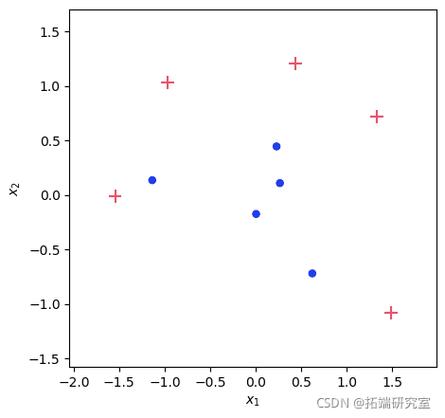

Python实现 (使用Scikit-learn) Scikit-learn提供了非常方便的

AdaBoostClassifier。

import numpy as np

import matplotlib.pyplot as plt

from sklearn.datasets import make_classification

from sklearn.model_selection import train_test_split

from sklearn.ensemble import AdaBoostClassifier

from sklearn.tree import DecisionTreeClassifier

from sklearn.metrics import accuracy_score

# 1. 生成模拟数据

X, y = make_classification(n_samples=1000, n_features=20, n_informative=2,

n_redundant=10, random_state=42)

X_train, X_test, y_train, y_test = train_test_split(X, y, test_size=0.3, random_state=42)

# 2. 创建并训练AdaBoost模型

# base_estimator: 基础学习器,默认是深度为1的决策树

# n_estimators: 弱学习器的数量

# learning_rate: 学习率,用于缩放每个弱学习器的权重

ada_clf = AdaBoostClassifier(

base_estimator=DecisionTreeClassifier(max_depth=1),

n_estimators=50,

learning_rate=1.0,

random_state=42

)

ada_clf.fit(X_train, y_train)

# 3. 预测与评估

y_pred = ada_clf.predict(X_test)

print(f"AdaBoost模型准确率: {accuracy_score(y_test, y_pred):.4f}")

# 可以观察每个基学习器的权重

print("\n每个基学习器的权重:")

print(ada_clf.estimator_weights_)

2 GBDT (Gradient Boosting Decision Tree) - 进化之王

如果说AdaBoost是“加权调整样本”,那么GBDT就是“沿着梯度方向修正误差”,这是它的一大飞跃。

-

核心机制: GBDT不再使用样本权重,而是使用梯度下降的思想。

- 初始预测:用一个简单的模型(如预测样本标签的平均值)作为初始预测值。

- 计算残差:计算当前模型预测值与真实值之间的差距,即“残差”(Residual),这个残差就是下一个模型需要学习的目标。

- 拟合残差:训练一个新的弱学习器(通常是CART回归树),让它去拟合这些残差。

- 更新预测值:将新训练出的模型的预测结果(乘以一个学习率后)加到之前的总预测值上。

- 循环:重复步骤2-4,每次都去拟合上一次模型的残差,直到残差变得非常小。

-

Python实现 (使用Scikit-learn)

GradientBoostingClassifier是GBDT的标准实现。

from sklearn.ensemble import GradientBoostingClassifier

# 1. 创建并训练GBDT模型

# n_estimators: 弱学习器(回归树)的数量

# learning_rate: 学习率,通常较小,如0.1, 0.01

# max_depth: 单棵树的深度

gbdt_clf = GradientBoostingClassifier(

n_estimators=100,

learning_rate=0.1,

max_depth=3,

random_state=42

)

gbdt_clf.fit(X_train, y_train)

# 2. 预测与评估

y_pred_gbdt = gbdt_clf.predict(X_test)

print(f"GBDT模型准确率: {accuracy_score(y_test, y_pred_gbdt):.4f}")

3 XGBoost (eXtreme Gradient Boosting) - 终极武器

XGBoost并不是一个全新的算法,而是GBDT的“极致优化版”,它在GBDT的基础上进行了大量工程和算法上的改进,使其成为当今数据科学竞赛和工业界的绝对霸主。

-

核心优势:

- 正则化:在目标函数中加入了L1和L2正则化项,有效控制模型复杂度,防止过拟合。

- 处理缺失值:能够自动学习处理特征中的缺失值,无需手动填充。

- 并行化:虽然Boosting是串行算法,但XGBoost在特征粒度上进行了并行计算,大大提升了训练速度。

- 灵活性高:支持自定义损失函数和评估指标,功能非常强大。

- 更精确的分裂算法:使用“近似算法”来寻找分裂点,在保证精度的同时,显著提升了速度。

-

Python实现 (安装xgboost库) 首先需要安装:

pip install xgboost

import xgboost as xgb

# 1. 创建并训练XGBoost模型

# XGBoost有自己的DMatrix数据结构,优化了内存和速度

dtrain = xgb.DMatrix(X_train, label=y_train)

dtest = xgb.DMatrix(X_test, label=y_test)

# 定义参数

params = {

'objective': 'binary:logistic', # 二分类问题

'max_depth': 3,

'eta': 0.1, # 学习率

'subsample': 0.8, # 样本采样比例

'colsample_bytree': 0.8, # 特征采样比例

'seed': 42

}

# 训练模型

num_rounds = 100

xgb_model = xgb.train(params, dtrain, num_rounds)

# 2. 预测与评估

y_pred_xgb = xgb_model.predict(dtest)

# 将概率值转换为类别 (0或1)

y_pred_xgb_class = [1 if p > 0.5 else 0 for p in y_pred_xgb]

print(f"XGBoost模型准确率: {accuracy_score(y_test, y_pred_xgb_class):.4f}")

算法对比与如何选择

| 特性 | AdaBoost | GBDT | XGBoost |

|---|---|---|---|

| 核心思想 | 调整样本权重 | 沿着梯度拟合残差 | GBDT的工程与算法优化版 |

| 对异常值 | 敏感(因为错误样本权重会急剧增加) | 相对稳健 | 非常稳健(有正则化约束) |

| 过拟合控制 | 一般(依赖弱学习器数量和学习率) | 较好(依赖学习率和树深度) | 极强(内置正则化、剪枝等) |

| 训练速度 | 较慢 | 较慢 | 非常快(并行、近似算法) |

| 易用性 | 高(Scikit-learn集成) | 高(Scikit-learn集成) | 中(需安装独立库,参数多) |

| 适用场景 | 简单问题,作为基准模型 | 通用性强,性能优异 | 竞赛、大规模数据、追求极致性能 |

如何选择?

- 新手入门/快速验证:从

AdaBoost或Scikit-learn的GradientBoostingClassifier开始,它们简单直接,易于理解。 - 工业界通用场景:

Scikit-learn的GradientBoostingClassifier已经足够强大,且与Scikit-learn生态无缝衔接。 - 竞赛/追求SOTA性能:XGBoost是你的不二之选,它在绝大多数情况下都能提供最好的性能,并且拥有丰富的调参空间。

- 新兴挑战者:不要忘记

LightGBM,由微软开源,速度比XGBoost更快,尤其在海量数据上优势明显,是XGBoost的有力竞争者。

Boosting模型调参技巧

Boosting模型性能的好坏,很大程度上取决于超参数的调优,以下是一些关键参数:

n_estimators(或num_rounds): 弱学习器的数量。- 技巧:通常设置一个较大的值(如100-1000),然后使用早停机制,当验证集上的性能不再提升时,就停止训练,防止过拟合。

learning_rate(或eta): 学习率,也叫收缩率。- 技巧:这是一个Trade-off(权衡)参数,较小的学习率通常需要更多的

n_estimators,但模型更稳定,泛化能力更好,常见的范围是[0.01, 0.2]。

- 技巧:这是一个Trade-off(权衡)参数,较小的学习率通常需要更多的

max_depth: 单棵决策树的最大深度。- 技巧:控制模型的复杂度,值越大,模型越复杂,越容易过拟合,对于XGBoost/LightGBM,通常设置在

3-10之间。

- 技巧:控制模型的复杂度,值越大,模型越复杂,越容易过拟合,对于XGBoost/LightGBM,通常设置在

subsample: 训练每棵树时,使用的样本比例(类似随机森林的行采样)。- 技巧:设置在

[0.7, 1.0)之间可以增加随机性,防止过拟合,提升模型鲁棒性。

- 技巧:设置在

colsample_bytree: 训练每棵树时,使用的特征比例(类似随机森林的列采样)。- 技巧:同样用于增加随机性,防止过拟合。

总结与展望

我们深入探索了Boosting算法的奇妙世界,从AdaBoost的“关注错误样本”,到GBDT的“沿梯度修正”,再到XGBoost的“极致优化”,我们看到了这一系列算法如何一步步走向强大。

Boosting的核心魅力在于,它将许多“平庸”的弱学习器,通过精妙的组合策略,凝聚成一个“卓越”的强学习器。 这不仅是一种算法,更是一种解决问题的哲学:持续迭代,不断从错误中学习,最终达到卓越。

作为Python程序员和数据科学家,掌握Boosting算法,尤其是XGBoost,是你提升模型性能、解决复杂问题、在职业道路上脱颖而出的关键一步。

打开你的Jupyter Notebook,亲手运行这些代码,尝试调整参数,感受Boosting算法带来的性能飞跃吧!机器学习的世界,正等待你去探索和征服。

#Boosting算法 #Python #机器学习 #XGBoost #GBDT #AdaBoost #数据科学 #集成学习