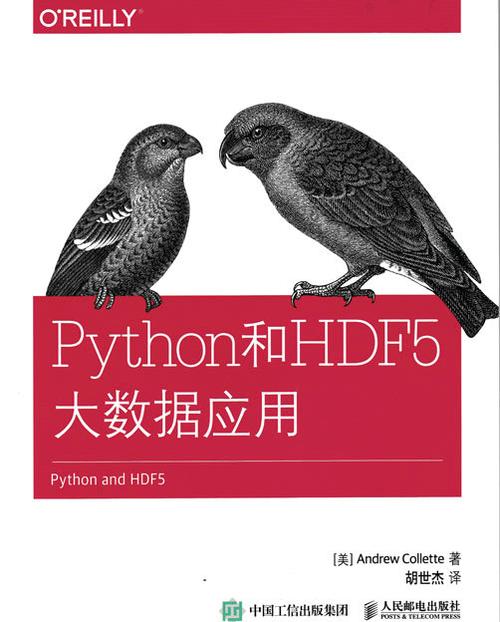

什么是 HDF5?

HDF5 (Hierarchical Data Format version 5) 是一种为存储和管理超大规模科学数据而设计的高性能文件格式和技术套件,你可以把它想象成一个“超级硬盘上的数据库”。

它的核心特性使其非常适合大数据:

- 分层结构:类似于文件系统,HDF5 使用“组”来组织数据,组可以包含其他组或数据集,形成一个树状结构,这使得数据管理非常清晰。

- 数据集:这是 HDF5 中实际存储数据的地方,它可以是多维数组(如 NumPy 数组),并且支持压缩,可以极大地减少存储空间。

- 元数据:HDF5 允许你为数据集和组附加丰富的描述性信息(属性),比如单位、创建者、实验参数等,这增强了数据的自描述性。

- 高性能:HDF5 针对磁盘 I/O 和内存访问进行了高度优化,它支持分块存储,这意味着你可以只读取一个巨大数据集的一小部分,而无需加载整个文件,这对于大数据处理至关重要。

- 可扩展性:单个 HDF5 文件可以存储 PB(10¹⁵ 字节)级别的数据。

Python 与 HDF5 的桥梁:h5py 库

Python 中与 HDF5 交互的标准库是 h5py,它提供了一个高级、直观的 Pythonic 接口,让你可以像操作字典和 NumPy 数组一样操作 HDF5 文件。

安装 h5py:

pip install h5py numpy

为什么 Python + HDF5 是大数据应用的黄金搭档?

-

生态系统无缝集成:

(图片来源网络,侵删)

(图片来源网络,侵删)- NumPy:

h5py可以直接读写 NumPy 数组,这是 Python 数据科学的核心,你可以将一个复杂的 NumPy 数组直接存入 HDF5 文件,稍后再读取回来,而无需任何格式转换。 - Pandas:Pandas 的

DataFrame可以被轻松地转换为 NumPy 数组或字典,然后存入 HDF5,虽然 Pandas 也有自己的 HDF5 存储 (pd.HDFStore),但h5py提供了更底层、更灵活的控制。 - Dask:对于超出内存的超大数据集,Dask 可以创建一个 HDF5 文件的“虚拟”数据集视图,并对其进行并行分块计算,而无需将数据全部加载到内存中。

- Scikit-learn / TensorFlow / PyTorch:在机器学习中,HDF5 常用于存储大量的训练数据(如图像、时间序列)或模型的权重和参数。

- NumPy:

-

高效的 I/O 性能:

- 对于无法一次性装入内存的大数组,HDF5 的“分块”特性允许你按需读取数据,大大降低了内存压力。

- 内置的压缩算法(如

gzip,lzf)可以在写入时自动压缩数据,在读取时解压,以空间换时间,非常适合存储成本敏感的场景。

-

数据持久化和版本控制:

- 将整个实验的数据、参数、中间结果和最终模型都保存在一个结构化的 HDF5 文件中,比散落在几十个 CSV 文件中要整洁得多。

- 通过修改组名或数据集,可以方便地创建不同版本的实验数据。

实践:使用 h5py 进行大数据操作

下面通过一个完整的例子来展示如何创建、写入、读取和查询一个 HDF5 文件。

场景:模拟一个实验数据集

假设我们有一个实验,产生了 1000 个“样本”,每个样本包含一个 100x100 的传感器读数(矩阵)和一个包含 10 个特征的描述向量。

import numpy as np

import h5py

# --- 1. 准备模拟大数据 ---

num_samples = 1000

sensor_shape = (100, 100)

feature_shape = (10,)

# 生成模拟数据

# 为了演示,我们创建一些随机数据

# 在真实场景中,这些数据可能来自文件或网络流

sensor_data = np.random.rand(num_samples, *sensor_shape)

feature_data = np.random.rand(num_samples, *feature_shape)

sample_labels = [f"sample_{i:04d}" for i in range(num_samples)]

print(f"准备的数据大小:")

print(f"传感器数据: {sensor_data.nbytes / 1024**2:.2f} MB")

print(f"特征数据: {feature_data.nbytes / 1024**2:.2f} MB")

# --- 2. 创建并写入 HDF5 文件 ---

filename = "experiment_data.h5"

with h5py.File(filename, "w") as hdf: # "w" 表示写入模式,会覆盖已存在的文件

# 创建一个主组,代表这次实验

experiment_group = hdf.create_group("experiment_2025-10-27")

# 在实验组下创建两个数据集

# compression="gzip" 是一个关键参数,用于压缩数据

# chunks=True 启用分块存储,对大数据至关重要

dset_sensors = experiment_group.create_dataset(

"sensor_readings",

data=sensor_data,

compression="gzip",

chunks=True

)

dset_features = experiment_group.create_dataset(

"feature_vectors",

data=feature_data,

compression="gzip",

chunks=True

)

# 添加元数据(属性)

experiment_group.attrs["creator"] = "Dr. Smith"

experiment_group.attrs["description"] = "Initial simulation run"

dset_sensors.attrs["unit"] = "microvolts"

dset_features.attrs["unit"] = "dimensionless"

# 我们也可以将样本名存储为一个单独的数据集

experiment_group.create_dataset("sample_names", data=sample_labels)

print(f"\n成功创建 HDF5 文件: {filename}")

print("文件结构:")

hdf.visititems(lambda name, obj: print(f" {name}: {obj}")) # 打印文件结构

# --- 3. 从 HDF5 文件中读取数据 ---

print("\n--- 从 HDF5 文件中读取数据 ---")

with h5py.File(filename, "r") as hdf: # "r" 表示只读模式

# 通过路径访问数据集

experiment_group = hdf["experiment_2025-10-27"]

# 读取整个数据集(如果内存足够)

# loaded_sensor_data = experiment_group["sensor_readings"][:]

# print(f"加载的传感器数据形状: {loaded_sensor_data.shape}")

# 更常见的做法:只读取一小部分数据(大数据应用的核心)

# 读取第 5 个样本的传感器数据

sample_5_sensors = experiment_group["sensor_readings"][5, :, :]

print(f"读取的样本5传感器数据形状: {sample_5_sensors.shape}")

# 读取前10个样本的特征向量

first_10_features = experiment_group["feature_vectors"][:10, :]

print(f"读取的前10个特征向量形状: {first_10_features.shape}")

# 读取元数据

creator = experiment_group.attrs["creator"]

sensor_unit = experiment_group["sensor_readings"].attrs["unit"]

print(f"实验创建者: {creator}")

print(f"传感器单位: {sensor_unit}")

# 遍历文件结构

print("\n文件内容:")

def print_structure(name, obj):

if isinstance(obj, h5py.Dataset):

print(f" Dataset: {name}, Shape: {obj.shape}, Type: {obj.dtype}")

elif isinstance(obj, h5py.Group):

print(f" Group: {name}")

hdf.visititems(print_structure)

大数据应用中的最佳实践和技巧

-

分块:对于大型数据集,始终设置

chunks=True,选择合适的块大小(通常是磁盘 I/O 块大小的倍数,如 1MB, 10MB)可以显著提高读取和写入性能。 -

压缩:使用

compression="gzip"或compression="lzf"。gzip压缩率更高但速度较慢,lzf速度更快但压缩率较低,对于需要频繁读取的数据,lzf可能是更好的选择。 -

只读取所需数据:这是 HDF5 相比其他格式(如 CSV)最大的优势,使用 NumPy 的切片语法

dataset[start:stop:step, ...]来精确加载你需要的部分,避免内存溢出。 -

并行 I/O (Advanced):

h5py支持通过 MPI-IO 进行并行读写,如果你使用 Dask 或 MPI 进行分布式计算,可以让每个进程/worker 直接读写 HDF5 文件的不同部分,实现真正的并行大数据处理。 -

使用

h5py的低级接口 (VDS - Virtual Datasets):对于将多个小文件或数据集逻辑上组合成一个大的虚拟数据集,h5py提供了虚拟数据集功能,这在处理数据分片时非常有用。 -

避免频繁打开/关闭文件:在循环中,尽量保持文件处于打开状态,完成所有操作后再关闭,频繁的打开和关闭文件会产生巨大的 I/O 开销。

替代方案:PyTables (基于 tables 库)

PyTables 是另一个流行的 Python 库,它也基于 HDF5 技术,但提供了更高级的面向对象接口和更强大的查询功能(类似于一个 NoSQL 数据库)。

h5py: 更接近 HDF5 的原生 API,接口简洁,与 NumPy 结合紧密。PyTables: 提供了Table对象,支持类似 SQL 的查询,对于需要对数据进行复杂筛选和分析的场景非常强大。

选择建议:

- 如果你的主要任务是高效地存储和读取大型 NumPy 数组,

h5py是首选。 - 如果你的数据有复杂的模式,并且需要对数据进行复杂的查询和过滤,

PyTables可能更合适。

| 特性 | 描述 |

|---|---|

| 强大组合 | Python (数据科学生态) + HDF5 (高性能存储格式) 是处理大规模结构化数据的理想选择。 |

| 核心优势 | 高效 I/O (分块读取)、数据压缩、分层组织、丰富元数据。 |

| 关键库 | h5py 是 Python 与 HDF5 交互的标准库,提供了直观的 API。 |

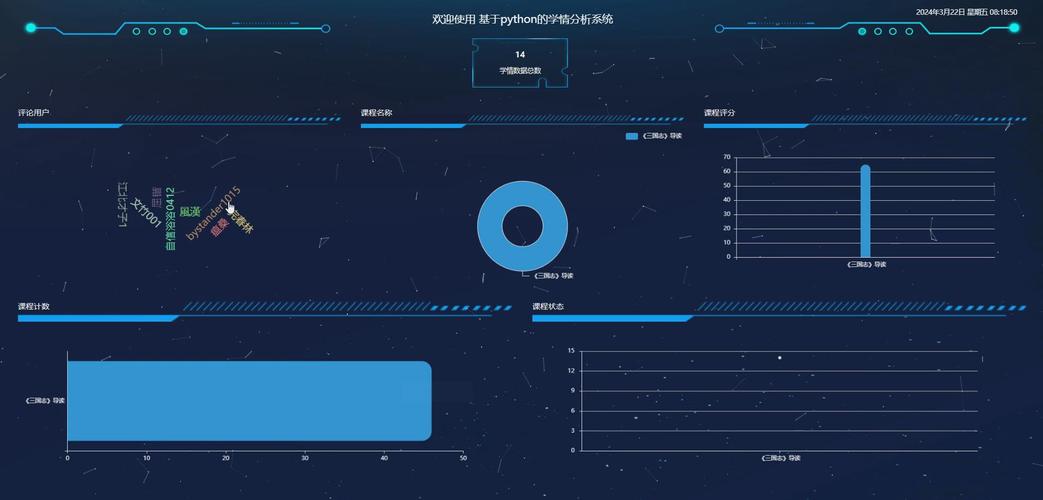

| 核心场景 | 科学计算模拟、金融时间序列分析、机器学习数据集存储、遥感图像数据管理。 |

| 最佳实践 | 始终使用分块和压缩,只读取所需数据,保持文件长时间打开以减少 I/O 开销。 |

掌握 Python 和 HDF5 的使用,意味着你拥有了处理和分析超出内存限制的庞大数据集的强大能力,是成为一名高级数据科学家或工程师的重要技能。