- AdaBoost 核心思想:它如何工作?

- Python 实现:使用

scikit-learn库。 - 完整代码示例:从数据准备到模型评估。

- AdaBoost 的优缺点:何时使用,何时不使用。

- 关键参数调优:如何优化模型性能。

AdaBoost 核心思想

AdaBoost 的核心思想是“关注错误”,它通过迭代的方式训练一系列弱学习器,每个新的学习器都更关注前一个学习器做错的样本。

工作流程可以概括为:

- 初始化样本权重:为训练集中的每一个样本赋予一个初始权重,通常是

1/N(N 是样本总数),这意味着一开始,所有样本的地位都是平等的。 - 迭代训练弱学习器:

- 在第

t次迭代中,使用当前的样本权重来训练一个弱学习器h_t(x)。 - 计算这个弱学习器的加权错误率

ε_t,这个错误率考虑了样本的权重,做错的样本权重越大,对错误率的贡献也越大。

- 在第

- 计算学习器权重:

- 根据错误率

ε_t计算这个弱学习器在最终模型中的权重α_t。 - 关键点:

ε_t很小(说明学习器表现好),则α_t会很大,这个学习器在最终投票中的话语权就重。ε_t很大(接近0.5,比随机猜测好不了多少),则α_t会很小,甚至为负,话语权就轻。

- 根据错误率

- 更新样本权重:

- 增加被当前学习器预测错误的样本的权重。

- 减少被当前学习器预测正确的样本的权重。

- 这样,下一个学习器在训练时,就会被迫更加关注那些“难啃的骨头”(即之前被做错的样本)。

- 最终模型构建:

- 将所有训练好的弱学习器

h_1, h_2, ..., h_T加权组合起来。 - 预测时,新样本会通过所有弱学习器,每个学习器的预测结果会根据其权重

α_t进行投票,得票最多的类别就是最终的预测结果。

- 将所有训练好的弱学习器

一个简单的比喻: 想象一个学生(弱学习器)在考试,第一次他做错了第5题和第10题,老师(AdaBoost)在下一次复习时,会特别强调第5题和第10题,这个学生下次做这两题的正确率就会提高,但可能又做错了其他题,老师接着再针对新的错题进行强调,经过多次“针对性辅导”(迭代),学生最终掌握了所有知识点,成为一个“学霸”(强学习器)。

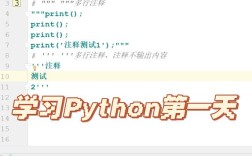

Python 实现 (使用 scikit-learn)

scikit-learn 库提供了非常方便的 AdaBoostClassifier 和 AdaBoostRegressor 类,我们这里重点讲解分类器。

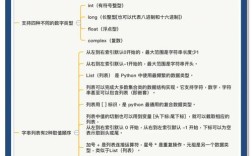

主要参数:

base_estimator: 弱学习器,默认是DecisionTreeClassifier(max_depth=1),也就是一个决策树桩(只有一层分裂的树),这是一个非常经典的弱学习器。n_estimators: 弱学习器的数量,数量越多,模型越复杂,但也更容易过拟合,需要通过交叉验证来选择。learning_rate: 学习率,也叫收缩因子。- 它用于缩放每个弱学习器权重

α_t。 - 较小的

learning_rate意味着需要更多的n_estimators才能达到同样的效果,但通常模型的泛化能力会更好(更不容易过拟合)。 - 这是一个非常重要的权衡参数。

- 它用于缩放每个弱学习器权重

algorithm: 使用的 boosting 算法,可以是'SAMME'或'SAMME.R'。'SAMME.R'是基于概率的版本,通常收敛更快,效果更好,是默认选项。

完整代码示例

下面我们通过一个经典的分类数据集 make_classification 来演示 AdaBoost 的应用。

# 1. 导入必要的库

import numpy as np

import matplotlib.pyplot as plt

from sklearn.datasets import make_classification

from sklearn.model_selection import train_test_split

from sklearn.ensemble import AdaBoostClassifier

from sklearn.tree import DecisionTreeClassifier

from sklearn.metrics import accuracy_score, classification_report, confusion_matrix

# 2. 生成或加载数据

# 创建一个可分类的数据集,包含2个特征,便于可视化

X, y = make_classification(

n_samples=1000, # 1000个样本

n_features=2, # 2个特征

n_informative=2, # 其中2个是有效特征

n_redundant=0, # 0个冗余特征

n_classes=3, # 3个类别

n_clusters_per_class=1,

random_state=42 # 随机种子,保证可复现性

)

# 3. 划分训练集和测试集

X_train, X_test, y_train, y_test = train_test_split(X, y, test_size=0.3, random_state=42)

# 4. 初始化并训练 AdaBoost 模型

# 使用默认的决策树桩作为弱学习器

# n_estimators=50, learning_rate=1.0 是默认值

ada_clf = AdaBoostClassifier(

n_estimators=50,

learning_rate=1.0,

random_state=42

)

print("开始训练 AdaBoost 模型...")

ada_clf.fit(X_train, y_train)

print("模型训练完成!")

# 5. 在测试集上进行预测

y_pred = ada_clf.predict(X_test)

# 6. 评估模型性能

accuracy = accuracy_score(y_test, y_pred)

print(f"\n模型在测试集上的准确率: {accuracy:.4f}")

# 打印更详细的分类报告

print("\n分类报告:")

print(classification_report(y_test, y_pred))

# 打印混淆矩阵

print("\n混淆矩阵:")

print(confusion_matrix(y_test, y_pred))

# 7. 可视化决策边界 (仅适用于2D数据)

def plot_decision_boundary(clf, X, y):

# 创建网格点

x_min, x_max = X[:, 0].min() - 1, X[:, 0].max() + 1

y_min, y_max = X[:, 1].min() - 1, X[:, 1].max() + 1

xx, yy = np.meshgrid(np.arange(x_min, x_max, 0.02),

np.arange(y_min, y_max, 0.02))

# 预测网格点的类别

Z = clf.predict(np.c_[xx.ravel(), yy.ravel()])

Z = Z.reshape(xx.shape)

# 绘制决策边界和数据点

plt.figure(figsize=(10, 7))

plt.contourf(xx, yy, Z, alpha=0.3)

scatter = plt.scatter(X[:, 0], X[:, 1], c=y, edgecolor='k', s=20, cmap=plt.cm.Paired)

plt.title(f"AdaBoost Decision Boundary (Accuracy: {accuracy:.2f})")

plt.xlabel("Feature 1")

plt.ylabel("Feature 2")

plt.legend(handles=scatter.legend_elements()[0], labels=['Class 0', 'Class 1', 'Class 2'])

plt.show()

plot_decision_boundary(ada_clf, X_test, y_test)

# 8. 可视化弱学习器的贡献

# AdaBoost 会记录每个弱学习器的权重

estimator_weights = ada_clf.estimator_weights_

estimator_errors = ada_clf.estimator_errors_

plt.figure(figsize=(12, 5))

plt.subplot(1, 2, 1)

plt.plot(range(1, len(estimator_weights) + 1), estimator_weights, marker='o')"每个弱学习器的权重")

plt.xlabel("弱学习器序号")

plt.ylabel("权重 (alpha)")

plt.subplot(1, 2, 2)

plt.plot(range(1, len(estimator_errors) + 1), estimator_errors, marker='o', color='r')"每个弱学习器的加权错误率")

plt.xlabel("弱学习器序号")

plt.ylabel("错误率 (epsilon)")

plt.tight_layout()

plt.show()

代码解释:

- 步骤 2-3:我们创建了一个人造的、适合可视化的数据集,并将其划分为训练集和测试集。

- 步骤 4:我们创建了

AdaBoostClassifier实例并使用fit()方法进行训练,这个过程会自动完成前面提到的迭代训练、权重计算和样本权重更新。 - 步骤 5-6:使用训练好的模型对测试集进行预测,并通过

accuracy_score,classification_report和confusion_matrix来评估其性能。 - 步骤 7:

plot_decision_boundary函数绘制了模型的决策边界,你可以直观地看到 AdaBoost 如何通过组合多个简单的决策边界来形成一个复杂的、非线性的决策区域。 - 步骤 8:我们可视化每个弱学习器的权重和错误率,你可以观察到,随着迭代次数的增加,错误率总体呈下降趋势,而那些错误率低的“优秀”学习器会获得更高的权重。

AdaBoost 的优缺点

优点:

- 精度高:作为集成方法,通常能取得很高的分类精度。

- 不易过拟合:与很多复杂的模型(如深度神经网络)相比,AdaBoost 对噪声和异常值相对不那么敏感,不容易过拟合,尤其是在

learning_rate较小的情况下。 - 简单易用:

scikit-learn中的实现非常简单,参数调优相对直观。 - 自带特征选择:在构建弱学习器(如决策树)时,AdaBoost 会倾向于选择那些能最大程度降低错误率的特征,因此具有一定的特征选择能力。

缺点:

- 对噪声和异常值敏感:因为 AdaBoost 会不断给错分样本增加权重,如果数据集中存在标签错误的样本(噪声),这些“坏”样本会得到极大的关注,从而严重影响模型的最终性能。

- 训练耗时:它是串行训练的,每个弱学习器都必须等前一个训练完成后才能开始,训练时间通常比并行训练的模型(如 Random Forest)要长。

- 需要调参:

n_estimators和learning_rate之间存在权衡,需要仔细调整才能达到最佳效果。

关键参数调优

调优 AdaBoost 主要就是调整 n_estimators 和 learning_rate。

-

n_estimators(弱学习器数量):- 太少:模型欠拟合,无法捕捉数据的复杂模式。

- 太多:模型可能过拟合,在训练集上表现完美,但在测试集上表现差。

- 调优方法:可以使用

GridSearchCV或RandomizedSearchCV来寻找一个合适的值,通常可以从 50 开始,逐步增加到 200 或 500,观察交叉验证分数的变化,当分数不再显著提升时就可以停止。

-

learning_rate(学习率):- 太大:每个弱学习器的权重变化剧烈,模型可能不稳定,容易过拟合。

- 太小:模型收敛非常缓慢,需要非常多的

n_estimators才能达到理想效果,计算成本高。 - 调优方法:通常与

n_estimators联合调优,一个常见的策略是先固定一个较大的learning_rate(如 1.0),然后增加n_estimators直到模型性能饱和,尝试降低learning_rate(如 0.5, 0.1, 0.05),并相应地增加n_estimators,看看是否能获得更好的泛化性能。

调优示例 (使用 GridSearchCV):

from sklearn.model_selection import GridSearchCV

# 定义参数网格

param_grid = {

'n_estimators': [50, 100, 200, 500],

'learning_rate': [0.01, 0.1, 0.5, 1.0, 1.5]

}

# 创建 AdaBoost 模型

ada = AdaBoostClassifier(random_state=42)

# 创建 GridSearchCV 对象

# cv=5 表示 5 折交叉验证

grid_search = GridSearchCV(estimator=ada, param_grid=param_grid, cv=5, n_jobs=-1, scoring='accuracy')

print("开始 Grid Search 调优...")

grid_search.fit(X_train, y_train)

print("Grid Search 完成!")

# 输出最佳参数和最佳得分

print(f"\n最佳参数: {grid_search.best_params_}")

print(f"最佳交叉验证准确率: {grid_search.best_score_:.4f}")

# 使用最佳模型进行预测

best_ada = grid_search.best_estimator_

y_pred_best = best_ada.predict(X_test)

print(f"\n最佳模型在测试集上的准确率: {accuracy_score(y_test, y_pred_best):.4f}")

AdaBoost 是一个强大且经典的集成算法,通过迭代地聚焦于错误样本来提升模型性能,在 Python 中,使用 scikit-learn 可以非常方便地实现它,虽然它对噪声敏感,但在许多分类和回归任务中都能表现出色,理解其核心思想,并掌握 n_estimators 和 learning_rate 的调优方法,是有效应用 AdaBoost 的关键。