核心观点:Python 是 Spark MLlib 的“最佳拍档”和“首选接口”

Spark MLlib 是 Spark 的核心机器学习库,而 Python 是与它交互最方便、最强大、最流行的语言。

你可以把它们的关系理解为:

- Spark MLlib:是提供强大计算能力的“引擎”和“工具箱”。

- Python:是驾驶这个引擎、使用这些工具箱的“方向盘”和“仪表盘”。

你完全可以用 Scala 或 Java 来直接使用 Spark MLlib,但 Python(尤其是结合了 PySpark 库)提供了更简洁、更易于上手的语法,以及丰富的数据科学生态(如 NumPy, Pandas, Matplotlib)。

Spark MLlib 是什么?

Spark MLlib 是 Apache Spark 的一个可扩展的机器学习库,它被设计用于处理大规模数据集,它的核心优势在于分布式计算。

主要特点:

- 分布式:它可以在由成百上千台机器组成的集群上运行,将数据和计算任务分布到各个节点上,从而处理单机无法企及的海量数据(TB 甚至 PB 级别)。

- 易用性:提供了高级的、类似于 Scikit-learn 的 API,如

Pipeline(管道)、Transformer(转换器)、Estimator(估计器)等,使得构建复杂的机器学习流程变得非常简单。 - 全面性:涵盖了机器学习的主要任务:

- 分类与回归:逻辑回归、线性回归、决策树、随机森林、梯度提升树、朴素贝叶斯、支持向量机等。

- 聚类:K-Means、GMM (高斯混合模型)、LDA (主题模型) 等。

- 协同过滤:用于推荐系统。

- 降维:PCA (主成分分析)、SVD (奇异值分解) 等。

- 特征工程:特征提取、转换、选择(如 TF-IDF, Word2Vec, StandardScaler, VectorAssembler)。

- 模型评估与调优:交叉验证、超参数调优(

CrossValidator,TrainValidationSplit)。

- 与 Spark 生态无缝集成:可以轻松地与 Spark SQL、Spark Streaming、GraphX 等其他 Spark 组件结合,构建端到端的数据应用。

Python 在 Spark 生态系统中的角色:PySpark

当 Python 与 Spark 结合时,我们通常称之为 PySpark,PySpark 是 Spark 的 Python API,它让你可以用 Python 语言来编写 Spark 应用程序。

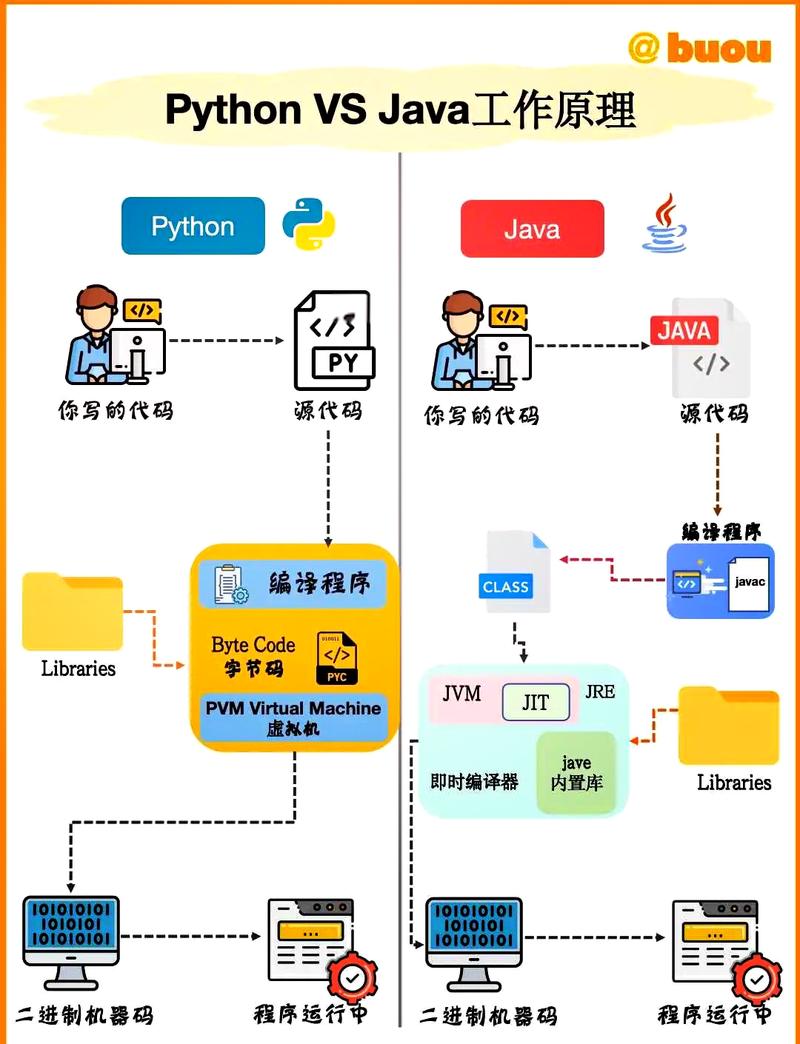

PySpark 如何工作?

这背后是一个“桥梁”机制:

- Driver Program:你的 Python 脚本在本地(或在集群的 Driver 节点)运行。

- SparkContext:你的 Python 代码通过一个叫做

SparkContext(或更高层的SparkSession) 的对象与 Spark 集群进行通信。 - Py4J Gateway:这是一个关键组件,它在 JVM(Java 虚拟机)和 Python 解释器之间建立了一个网关,你的 Python 代码通过这个网关,将指令“翻译”成 JVM 能理解的 Java/Scala 代码。

- Spark Cluster:Spark 集群(由 JVM 运行)接收到指令后,负责实际的分布式数据调度和计算。

这种架构的好处:

- Python 的易用性:你可以享受 Python 丰富的库、简洁的语法和快速的开发效率。

- Spark 的性能:底层的计算仍然在高度优化的 JVM 上进行,充分利用了 Spark 的分布式性能。

如何使用 Python (PySpark) 和 MLlib:一个简单示例

下面是一个完整的端到端示例,展示如何使用 PySpark 和 MLlib 来训练一个逻辑回归模型,这个流程是所有机器学习项目的标准流程。

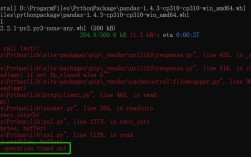

环境准备: 确保你已经安装了 Java 和 Spark,然后通过 pip 安装 PySpark:

pip install pyspark

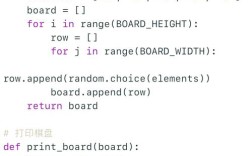

代码示例:

from pyspark.sql import SparkSession

from pyspark.ml.classification import LogisticRegression

from pyspark.ml.feature import VectorAssembler

from pyspark.ml.evaluation import BinaryClassificationEvaluator

# --- 1. 创建 SparkSession ---

# 这是所有 PySpark 应用程序的入口点

spark = SparkSession.builder \

.appName("MLlib_Logistic_Regression_Example") \

.getOrCreate()

# --- 2. 准备数据 ---

# 在实际项目中,数据通常来自 HDFS, S3, Hive, Kafka 等。

# 这里我们创建一个本地的 Spark DataFrame 来模拟数据。

# 假设我们有两个特征: "feature1", "feature2" 和一个标签: "label"

data = [

(1.0, 2.0, 0),

(2.0, 3.0, 0),

(3.0, 1.0, 1),

(4.0, 5.0, 1),

(5.0, 4.0, 1),

(6.0, 7.0, 0)

]

columns = ["feature1", "feature2", "label"]

df = spark.createDataFrame(data, columns)

print("原始数据:")

df.show()

# --- 3. 特征工程 ---

# MLlib 的模型需要一个名为 "features" 的向量列作为输入。

# VectorAssembler 用于将多个列合并成一个特征向量。

assembler = VectorAssembler(

inputCols=["feature1", "feature2"],

outputCol="features"

)

# 应用转换器

data_with_features = assembler.transform(df)

print("合并特征后的数据:")

data_with_features.show()

# --- 4. 划分训练集和测试集 ---

train_data, test_data = data_with_features.randomSplit([0.7, 0.3], seed=42)

# --- 5. 创建和训练模型 ---

# 创建一个逻辑回归估计器

lr = LogisticRegression(featuresCol="features", labelCol="label", maxIter=10)

# 使用训练数据来拟合模型(训练)

model = lr.fit(train_data)

print("模型训练完成!")

# --- 6. 进行预测 ---

# 使用训练好的模型对测试数据进行预测

predictions = model.transform(test_data)

print("预测结果:")

predictions.select("features", "label", "prediction", "probability").show()

# --- 7. 评估模型 ---

# 创建一个评估器

evaluator = BinaryClassificationEvaluator(rawPredictionCol="rawPrediction", labelCol="label", metricName="areaUnderROC")

# 计算测试集上的 AUC (Area Under the ROC Curve)

auc = evaluator.evaluate(predictions)

print(f"模型的 AUC (测试集) 为: {auc:.4f}")

# --- 8. 关闭 SparkSession ---

# 释放资源

spark.stop()

Python + Spark MLlib vs. Scikit-learn:如何选择?

这是一个非常关键的问题,决定了你应该在什么场景下使用哪个工具。

| 特性 | Python + Spark MLlib | Python + Scikit-learn |

|---|---|---|

| 核心定位 | 分布式、大数据 | 单机、中小数据 |

| 数据规模 | TB / PB 级别,数据可以分布在多台机器上。 | GB 级别,所有数据必须能加载到一台机器的内存中。 |

| 性能 | 高延迟,高吞吐,启动和调度有开销,但一旦运行,处理海量数据速度极快。 | 低延迟,对于小数据集,训练和预测速度非常快。 |

| 易用性 | API 设计借鉴了 Scikit-learn,概念相似(如 Pipeline),但语法更“重”,需要理解 Spark 的概念(如 RDD, DataFrame, Cluster)。 | 业界标准,API 设计优雅、直观,文档完善,学习曲线平缓。 |

| 生态系统 | 与整个 Spark 生态(SQL, Streaming, GraphX)深度集成。 | 与 Python 数据科学生态(NumPy, Pandas, Matplotlib, Seaborn)无缝集成。 |

| 部署 | 需要搭建和维护 Spark 集群(或在云平台上使用),相对复杂。 | 部署简单,只需要安装 Python 包即可。 |

选择指南:

-

选择 Scikit-learn,

- 你的数据集可以轻松地放入你的笔记本电脑或服务器的内存中(通常小于几十 GB)。

- 你正在快速进行原型设计、探索性数据分析或教学。

- 你需要利用 Pandas 进行数据预处理和 Matplotlib 进行可视化。

- 你的模型最终将部署在资源有限的环境中。

-

选择 Spark MLlib,

- 你的数据集非常大,单机内存无法容纳(日志数据、用户行为数据)。

- 你需要利用分布式计算来加速模型训练。

- 你已经有一个 Spark 集群(在 Databricks, AWS EMR, Azure Databricks 上),并且希望构建一个端到端的、可扩展的数据处理和机器学习流水线。

- 你的应用需要结合 Spark 的其他功能,比如用 Spark SQL 处理数据,然后用 MLlib 训练模型。

- Spark MLlib 是一个功能强大、专为大数据设计的分布式机器学习库。

- Python (PySpark) 是使用 Spark MLlib 的首选和最便捷的方式,它结合了 Python 的易用性和 Spark 的强大计算能力。

- 两者通过 Py4J 网关实现通信,让你能用 Python 驾驭底层的 JVM 计算引擎。

- Scikit-learn 和 Spark MLlib 不是竞争对手,而是互补的工具,前者是单机机器学习的“瑞士军刀”,后者是大数据分布式机器学习的“航空母舰”,选择哪个取决于你的数据规模和计算需求,在实践中,数据科学家常常会用 Scikit-learn 进行快速验证,然后用 Spark MLlib 在生产环境中处理全量数据。