下面我将从技术选型、核心算法、Java库、项目实践四个方面,为你提供一个全面且可操作的指南。

为什么选择Java进行机器学习?

虽然Python是机器学习领域的“王者”,但Java在企业级应用中占据着主导地位,选择Java进行ML开发有其独特的优势:

- 生态成熟稳定:拥有庞大的企业级应用生态,特别是在金融、电信、大型电商等领域。

- 高性能与可扩展性:Java的JVM(Java虚拟机)性能优异,适合处理大规模数据和构建高并发的在线服务(如实时推荐、风控模型)。

- 无缝集成:可以轻松地将ML模型集成到现有的Java后端系统中,如Spring Boot框架。

- 健壮性与维护性:Java的强类型和静态特性有助于构建大型、健壮且易于维护的代码库。

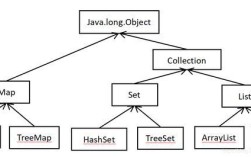

Java机器学习生态系统

Java的ML生态虽然不像Python那样“大一统”,但有几个非常出色的库,各有侧重。

| 库名称 | 核心特点 | 适用场景 |

|---|---|---|

| Deeplearning4j (DL4J) | 工业级深度学习框架,与Spark、TensorFlow、Keras集成良好,支持多种神经网络(CNN, RNN, GAN等)。 | 图像识别、自然语言处理、语音识别、推荐系统等复杂任务。 |

| Weka | 经典、学术界的瑞士军刀,提供丰富的数据预处理、分类、回归、聚类算法,图形化界面友好。 | 快速原型验证、数据挖掘教学、中小型数据集分析。 |

| Apache Spark MLlib | 大规模数据处理与机器学习,作为Spark的一部分,它专为分布式计算设计,能处理海量数据。 | 大数据场景下的机器学习,如日志分析、用户行为分析。 |

| Tribuo | 由Oracle Labs维护的现代ML库,设计上借鉴了scikit-learn的理念,易于使用,且支持模型导出(如ONNX)。 | 新项目开发,追求现代化API和模型可移植性。 |

| Eclipse Deeplearning4j (配合ND4J) | DL4J的底层计算引擎ND4J提供了类似NumPy的多维数组操作,是Java科学计算的基础。 | 底层数学计算、自定义神经网络层。 |

推荐路径:

- 初学者/快速验证:从 Weka 开始,感受ML的全流程。

- 生产级深度学习:Deeplearning4j 是不二之选。

- 大规模数据/已有Spark集群:Spark MLlib 是最佳选择。

- 现代化新项目:关注 Tribuo,它的API设计非常优秀。

核心实用机器学习技术及Java实现示例

我们将以最经典的 Weka 库为例,因为它简单直观,能很好地展示ML的核心流程,我们再讨论如何用更现代的库(如Tribuo或DL4J)构建深度学习模型。

核心流程

一个标准的ML项目通常包含以下步骤:

- 数据准备:加载数据、清洗、转换。

- 特征工程:选择、构建、缩放特征。

- 模型选择与训练:选择算法,用训练数据拟合模型。

- 模型评估:使用测试数据评估模型性能。

- 模型部署:将训练好的模型集成到应用中。

示例1:使用Weka进行分类任务(鸢尾花数据集)

这个例子将展示如何使用Weka的Java API来完成一个完整的分类任务。

添加Maven依赖

在你的 pom.xml 中添加Weka核心库:

<dependency>

<groupId>nz.ac.waikato.cms.weka</groupId>

<artifactId>weka-stable</artifactId>

<version>3.8.6</version> <!-- 请使用最新稳定版 -->

</dependency>

Java实现代码

import weka.core.Instances;

import weka.core.converters.ConverterUtils.DataSource;

import weka.classifiers.Classifier;

import weka.classifiers.trees.J48; // C4.5决策树算法

import weka.classifiers.Evaluation;

import weka.filters.Filter;

import weka.filters.unsupervised.attribute.Normalize; // 数据归一化

public class WekaClassificationExample {

public static void main(String[] args) throws Exception {

// 1. 数据准备

// 从ARFF文件加载数据,你也可以从CSV加载。

DataSource source = new DataSource("path/to/your/iris.arff");

Instances data = source.getDataSet();

// 设置类别属性(最后一列)

if (data.classIndex() == -1) {

data.setClassIndex(data.numAttributes() - 1);

}

// 2. 特征工程 (可选): 这里我们进行数据归一化

Normalize normalize = new Normalize();

normalize.setInputFormat(data);

Instances normalizedData = Filter.useFilter(data, normalize);

// 3. 模型选择与训练

// 我们选择J48(决策树)算法

Classifier classifier = new J48();

// 评估器,使用10折交叉验证

Evaluation evaluation = new Evaluation(normalizedData);

evaluation.crossValidateModel(classifier, normalizedData, 10, new java.util.Random(42));

// 4. 模型评估

System.out.println("=== 评估结果 ===");

System.out.println(evaluation.toSummaryString()); // 总体准确率等

System.out.println(evaluation.toClassDetailsString()); // 分类细节

System.out.println("混淆矩阵:\n" + evaluation.toMatrixString());

// 5. 模型部署 (训练最终模型)

// 在真实应用中,你会用全部数据来训练最终模型

classifier.buildClassifier(normalizedData);

// 保存模型到文件,以便后续加载

weka.core.SerializationHelper.write("j48_model.model", classifier);

System.out.println("\n模型已保存到 j48_model.model");

}

}

代码解读:

DataSource: 用于加载各种格式的数据文件。Instances: Weka中数据的核心表示,类似于一个带属性的表格。setClassIndex(): 指定哪一列是我们要预测的目标(类别)。J48: Weka中实现C4.5决策树算法的分类器,你可以轻松替换成NaiveBayes,SMO(SVM) 等。Evaluation: 评估器,用于计算模型的性能指标。crossValidateModel是评估模型泛化能力的标准方法。Filter: 用于数据预处理,如归一化、标准化、离散化等。weka.core.SerializationHelper: 用于将训练好的模型序列化到磁盘,这是模型部署的关键一步。

示例2:使用Tribuo进行多分类任务(MNIST)

Tribuo 的API设计更接近现代的Python库(如scikit-learn),非常适合构建更复杂的流程。

添加Maven依赖

<dependency>

<groupId>org.tribuo</groupId>

<artifactId>tribuo-all</artifactId>

<version>4.3.1</version> <!-- 请使用最新版 -->

</dependency>

Java实现代码(简化版)

import org.tribuo.*;

import org.tribuo.data.columnar.ColumnarIterator;

import org.tribuo.data.columnar.RowProcessor;

import org.tribuo.data.columnar.extractors.SimpleFieldExtractor;

import org.tribuo.data.columnar.extractors.SimpleSparseFeatureExtractor;

import org.tribuo.data.columnar.extractors.column.DoubleColumnExtractor;

import org.tribuo.data.columnar.extractors.column.StringColumnExtractor;

import org.tribuo.data.columnar.RowProcessorChain;

import org.tribuo.data.columnar.RowProcessorFactory;

import org.tribuo.data.columnar.RowProcessorOptions;

import org.tribuo.data.columnar.extractors.SimpleFieldExtractor;

import org.tribuo.data.columnar.extractors.column.DoubleColumnExtractor;

import org.tribuo.data.columnar.extractors.column.StringColumnExtractor;

import org.tribuo.data.columnar.RowProcessorChain;

import org.tribuo.data.columnar.RowProcessorFactory;

import org.tribuo.data.columnar.RowProcessorOptions;

import org.tribuo.data.columnar.RowProcessor;

import org.tribuo.data.columnar.ColumnarIterator;

import org.tribuo.data.columnar.RowProcessorChain;

import org.tribuo.data.columnar.RowProcessorFactory;

import org.tribuo.data.columnar.RowProcessorOptions;

import org.tribuo.data.columnar.extractors.SimpleFieldExtractor;

import org.tribuo.data.columnar.extractors.column.DoubleColumnExtractor;

import org.tribuo.data.columnar.extractors.column.StringColumnExtractor;

import org.tribuo.classification.*;

import org.tribuo.classification.evaluation.*;

import org.tribuo.classification.sgd.*;

import org.tribuo.data.columnar.RowProcessor;

import org.tribuo.data.columnar.RowProcessorChain;

import org.tribuo.data.columnar.RowProcessorFactory;

import org.tribuo.data.columnar.RowProcessorOptions;

import org.tribuo.data.columnar.extractors.SimpleFieldExtractor;

import org.tribuo.data.columnar.extractors.column.DoubleColumnExtractor;

import org.tribuo.data.columnar.extractors.column.StringColumnExtractor;

import org.tribuo.datasource.DataSource;

import org.tribuo.datasource.ListDataSource;

import org.tribuo.evaluation.Evaluation;

import org.tribuo.evaluation.RegressionEvaluation;

import org.tribuo.math.optimisers.AdaGrad;

import org.tribuo.regression.Regressor;

import org.tribuo.regression.RegressorFactory;

import org.tribuo.regression.evaluation.RegressionEvaluation;

import org.tribuo.regression.sgd.RegressionSGDTrainer;

import org.tribuo.regression.xgboost.XGBoostRegressionTrainer;

import java.io.IOException;

import java.nio.file.Files;

import java.nio.file.Path;

import java.util.ArrayList;

import java.util.List;

import java.util.stream.Stream;

public class TribuoClassificationExample {

public static void main(String[] args) throws IOException {

// 1. 准备数据

// 假设我们有一个CSV文件,第一列是标签,后面是784个像素值

Path path = Path.of("path/to/mnist_train.csv");

// 定义如何解析每一行

RowProcessor<Label> processor = new RowProcessorChain<>(

new RowProcessorFactory<>("label", new StringColumnExtractor<>(0), new LabelFactory()),

new RowProcessorFactory<>("features", new SimpleSparseFeatureExtractor("pixel_", 1, 784), new DoubleColumnExtractor<>(1, 784))

);

List<Example<Label>> examples = new ArrayList<>();

try (Stream<String> lines = Files.lines(path)) {

lines.skip(1).forEach(line -> {

Example<Label> example = processor.process(line);

if (example != null) {

examples.add(example);

}

});

}

// 创建数据集

MutableDataset<Label> dataset = new MutableDataset<>(examples);

// 2. 特征工程与模型训练

// 使用线性SGD分类器,带有L2正则化

// C++/Java中,正则化参数是lambda,值越大,正则化越强

// Tribuo的SGDTrainer中,参数是lambda

LinearSGDTrainer trainer = new LinearSGDTrainer(

new SquashedHinge(), // 损失函数

new AdaGrad(0.1), // 优化器

10, // 迭代次数

1.0, // L2正则化系数

1.0, // L1正则化系数

42 // 随机种子

);

// 3. 模型训练

Model<Label> model = trainer.train(dataset);

// 4. 模型评估

Evaluation<Label> evaluation = model.evaluate(dataset);

System.out.println("评估结果:");

System.out.println(evaluation.toString());

// 5. 模型部署

// Tribuo模型可以直接保存和加载

model.save("tribuo-linear-sgd-mnist");

System.out.println("模型已保存到 tribuo-linear-sgd-mnist");

}

}

代码解读:

RowProcessor: 这是Tribuo处理结构化数据的强大工具,你可以像配置管道一样定义如何从CSV/行数据中提取特征和标签。Example: 表示一个样本,由Features和Output(如Label)组成。MutableDataset: 内存中的数据集对象。LinearSGDTrainer: 一个线性模型的随机梯度下降训练器,可以用于分类或回归,你可以轻松换成CARTClassificationTrainer(决策树)或XGBoostClassificationTrainer。Evaluation: 提供详细的评估报告。

实用项目实践建议

-

从数据开始:

- 探索性数据分析:使用

Tribuo或自己写的代码,计算均值、方差、缺失值等,可视化是关键(可以使用Java的XChart或JFreeChart库)。 - 特征工程:这是ML成功的关键,尝试不同的特征组合、归一化/标准化、独热编码等。

- 探索性数据分析:使用

-

模型选择与调优:

- 基线模型:先用一个简单的模型(如逻辑回归、决策树)建立一个基线。

- 超参数调优:使用网格搜索或随机搜索。

Tribuo和Weka都提供了相关的工具。Spark MLlib的CrossValidator是分布式调优的利器。 - 模型解释性:对于业务场景,模型为什么这么决策和预测本身一样重要,决策树、线性模型的系数本身就具有很好的可解释性,对于复杂的深度学习模型,可以考虑使用

LIME或SHAP的Java实现(如果存在)或集成Python服务。

-

模型部署:

- 序列化模型:像Weka和Tribuo那样,将训练好的模型保存为文件。

- 构建预测服务:

- 简单方式:在Spring Boot应用中加载模型,提供一个REST API端点(

/predict),接收数据,返回预测结果。 - 高级方式:使用模型服务器,如 KServe (原KFServing) 或 Triton Inference Server,它们可以高效地管理多个版本的模型,提供高性能推理,并支持GPU。

- 简单方式:在Spring Boot应用中加载模型,提供一个REST API端点(

- 批处理:对于离线数据分析,可以使用Spark将模型应用在海量数据上。

| 技术领域 | 推荐Java库 | 关键点 |

|---|---|---|

| 快速原型/学术研究 | Weka | API简单,算法全面,图形化界面友好。 |

| 生产级深度学习 | Deeplearning4j (DL4J) | 与Spark集成,支持分布式训练,工业级稳定性。 |

| 大规模数据/Spark生态 | Spark MLlib | 无缝集成Spark集群,处理TB级数据。 |

| 现代化/Python风格API | Tribuo | API设计优秀,易于使用,模型导出能力强。 |

选择哪个库取决于你的具体需求:数据规模、任务复杂度以及团队的技术栈,从Weka或Tribuo入手是理解Java机器学习流程的好方法,当你需要处理更大规模或更复杂的任务时,再转向Spark MLlib或DL4J。

希望这份指南能帮助你开启在Java世界中进行实用机器学习的旅程!